KI, also "Künstliche Intelligenz", ist zu einem fast unerträglichen Reizwort geworden. Bei vielen gehen die Schotten sofort zu, sobald davon irgendwie die Rede ist...

KI, also "Künstliche Intelligenz", ist zu einem fast unerträglichen Reizwort geworden. Bei vielen gehen die Schotten sofort zu, sobald davon irgendwie die Rede ist.

KI, also "Künstliche Intelligenz", ist zu einem fast unerträglichen Reizwort geworden. Bei vielen gehen die Schotten sofort zu, sobald davon irgendwie die Rede ist.Nun mag man davon halten, was auch immer man möchte. Die meisten verbinden mit "KI" ohnehin fast nur LLM (Large Language Model), also so'n Kram wie ChatGPT__(Nummer hier einfügen), Grok, Gemini, Copilot, etc. ... also den "modernen Versionen" von Weizenbaums Eliza. Gut... die können oft mehr, als nur Schwätzen... man kann sich auch Bilder erstellen lassen oder man lässt den Bot Programmcode erzeugen.

Über den praktischen Nutzen und auch die möglichen Gefahren will ich hier nicht ausgiebig sprechen. Es muss jeder selbst entscheiden, ob und inwieweit er solche Dienste nutzt. Ich selbst nutze diese Dienste auch sporadisch. Mehrheitlich als Ausgangsbasis für eigene Recherchen. Wenn ich also etwas zu einem bestimmten Thema suche, stelle ich die Frage bei einem solchen Bot und beginne dann selbst anhand des Ergebnisses mit meinen Recherchen. Das ist schon praktisch... vor allem, wenn der Bot auch Quellenangaben macht. Und Artikelbilder, die selbst nur als "Schmuck" für einen Artikel dienen, lasse ich mir auch öfter einmal erstellen. Wobei ich bei solchen Bildern, die einfach nur wegen des einheitlichen Erscheinungsbildes sein "müssen", auch regelmäßig meine "natürliche Intelligenz" in Verbindung mit Gimp und meinen krummen Fingern an der Maus dazu nutze, aus CC0-Bildern und meinen beschränkten künstlerischen Fähigkeiten solche Bilder zu erstellen.

Und da wären wir dann auch schon beim Thema Nr. 1!Viele, welche öffentlich – und mit öffentlichen Inhalten – im Web agieren, sind strikt dagegen, dass (ich nenne sie jetzt mal vereinfachend) "KI-Engines" auch ihre "Daten" in ihre Ergebnisse mit einbeziehen. Vor allem, weil es an detaillierten Quellenangaben fehlt. Ok... nun denn. Wenn tatsächlich relevant lange Passagen z.B. aus veröffentlichten Texten 1:1 übernommen werden, dann gehört es sich auch, dass eine entsprechende Quellenangabe erscheint (und/oder andere Vorgaben einer eventuelle angegebenen Lizenz der Quelle). Das gilt aber sowohl für "künstliche", wie auch für "natürliche" Intelligenz. Wenn ich in Beiträgen ausführlich zitiere, dann wird das gekennzeichnet und die Quelle angegeben. Ob und wie das bei KI-generierten Texten funktioniert und stattfindet, weiß ich nicht. Da habe ich noch keine Erfahrungen... wahrscheinlich, weil ich diese Dienste nur sporadisch und – wir bereits erwähnt – als Startpunkt für eigene Recherchen nutze. Werden aber lediglich die Informationen gewonnen und entsprechend gewertet, eingeordnet und letztlich in neu erstellten Texten genutzt, dann ist das sowas wie "künstliches Lernen". Es gibt quasi "Erkenntnisgewinne". Wenn ich also zu einem Thema recherchiere, erweitere ich mein Wissen. Und dieses erlernte Wissen nutze ich dann in eigenen Texten. Das ist normal. Wenn ich etwas zu einem geografischen Thema schreiben würde, was auf meinem Wissen, welches ich in meinem bisherigen Leben angehäuft habe, basiert, so ist das doch ganz normal. Mir hat der Diercke-Atlas, den ich in der Schule genutzt habe, zum Glück nicht verboten, mir gewisse Dinge zu merken (neee... das ist ja Sinn und Zweck des schulischen Lernens) und später zu verwenden. Solange ich nicht knallhart plagiiere, ist das ok. Dem wird wohl niemand ernsthaft widersprechen wollen.

Wieso soll das nun bei der KI anders sein? Was ist so schlimm daran, wenn das "Wissen", welches sie "angehäuft" hat, von diesen Systemen bei Anfragen angewendet, also genutzt wird? Das Argument, dass solche Dienste letztlich auch immer irgendwie mit ihrem Dienstangebot Geld verdienen, ist auch kein Argument dagegen. Oben beispielhaft erwähnte (und echt utopische) Ausführungen zu einem erdkundlichen Thema könnte ich mir ja auch bezahlen lassen. Ich nutze also Wissen, welches ich aus anderen Quellen gesammelt habe, zu kommerziellen Zwecken. Na und? Normal! So funktioniert die Welt.

Bei ausführlichen Ausarbeitungen, Beiträgen, Artikeln kann ich es noch verstehen, wenn nicht jeder damit einverstanden ist, dass alles verwendet wird... wobei auch das ziemlich "schräg" ist. Denn wenn ich mir einen solchen Beitrag durchlesen und das dadurch gewonnene Wissen später in einem eigenen Beitrag verwenden würde, ohne zu plagiieren, sondern als eigene "Arbeit" formuliert, wird sich auch keine aufregen... oder? Oder doch? Falls doch, stellt sich mir die Frage: Wieso veröffentlicht denn dann jemand sowas? Wenn es doch eigentlich niemand lesen soll... weil dadurch ja die "Gefahr" besteht, dass der Leser die Erkenntnisse irgendwann selbst publizistisch nutzt. Wenn keiner etwas von meinem Werk haben soll, dann darf ich es schlicht nicht veröffentlichen.

Ganz besonders skurril finde ich die Protesthaltung bezüglich des Durchsuchens Sozialer Netzwerke. Euer Ernst, wenn Ihr meint, das müsse unterbunden werden? Erstmal ist das doch in der Regel nur Beifang, was die Dienste da einsammeln. Oder meint Ihr, Postings mit "guten Morgen", über das gerade eingenommene Mittagessen, über eine Etappe einer Radtour durch die Lüneburger Heide oder darüber, dass Sohn oder Tochter heute schon wieder das Pausenbrot unangerührt mit nach Hause gebracht hat, besäße eine wirkliche Relevanz für den Datenpool von LLMs? Das ist seichter Smalltalk. Das wird nicht wirklich gebraucht. Und bei ausführlicheren Beiträgen in diesen Netzwerken gilt das zuvor Gesagte: Wenn es keiner nutzen, lesen, verstehen, lernen soll, dann veröffentlicht es einfach nicht! Soziale Netzwerke... auch die dezentralen Netzwerke sind nunmal in der Regel komplett öffentlich. Wer da etwas postet, sollte sich im Klaren darüber sein, dass das JEDER lesen kann. Es gibt selbst im Fediverse nur wenige Dienste, die eine nicht-öffentlichen Nutzung innerhalb von sozialen Gruppen erlauben: mein geliebtes Hubzilla, dann auch Friendica, (streams) und Forte z.B.

Wer also nicht möchte, dass Postings durch KI-Dienste gecrawlt werden, muss einen solchen Dienst nutzen... und zwar so nutzen, dass es sich um einen nicht-öffentlichen Kanal handelt. Dann kommen da solche Akteure auch nicht dran.

Wer einen öffentlichen Dienst nutzt, welche dann über so schwache Mechanismen, wie eine robot.txt versucht, das Abgrasen zu verhindern, der betrügt sich selbst. Öffentlich ist öffentlich. Und was öffentlich ist, kann auch kaum einer Nutzerbeschränkung unterliegen.

Aber... wie gesagt... das ist eh ein Getrommel wegen Nichtigkeiten, wenn man sich die Timelines dieser Dienste anschaut.

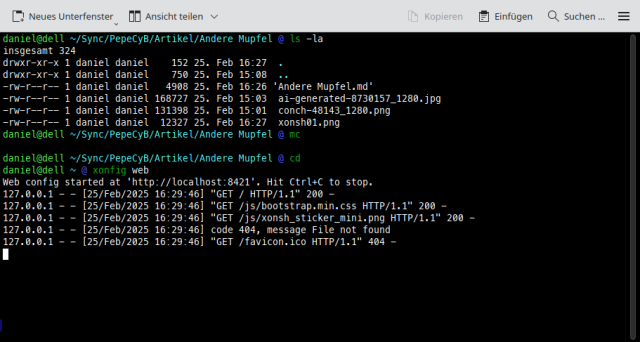

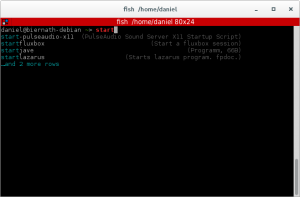

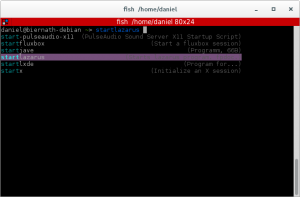

Jetzt zum Thema Nr. 2!Man findet immer mehr Software, welche bestimmte KI-Funktionen einbauen. Und da gibt es dann einen irrsinnigen Beißreflex. "

Neee, wenn mein Office-Programm jetzt auch KI anbietet, dann lösch ich das und suche mir ein anderes."

Was soll der Scheiß? Gerade erst las ich solche Aussagen bezüglich Onlyoffice. Da wird ein sehr gutes Stück Software verteufelt, weil jetzt KI-Funktionen angeboten werden. Die sind aber gar nicht automatisch aktiviert und müssen vom Nutzer ganz explizit eingeschaltet (und oft sogar mit einem Lizenzschlüssel für den jeweiligen Dienst freigeschaltet) werden... sofern sich der Nutzer der Software einen Nutzen davon verspricht. Ich für meinen Teil wüsste nicht, wozu ich das aktivieren sollte... ich brauche das nicht. Und weil ich es nicht aktiviere, ist der Rest der Software ja nicht schlechter als vorher. Aber ich maße mir doch nicht an, bestimmen zu wollen, dass andere Nutzer dieses Feature auch nicht nutzen sollen. Wer das braucht, soll es nutzen können. Und für den ist die Software dann auch "besser" als vorher. Und je mehr Programme solche Optionen einbauen, desto öfter liest man Boykott-Erklärungen oder gar Boykott-Aufrufe.

Echt mal... haltet Euch einfach aus meinem Leben raus! Ich entscheide selbst, was ich nutze und was nicht.Ganz anders sehe ich das nur, wenn mir solche Funktionen ungewollt aktiviert untergeschoben werden. Das empfinde ich als anmaßende Einmischung in mein Verhalten. Und wenn man es gar nicht abschalten kann, dann entscheide ich auch für mich selbst, dass ich die Software nicht mal mit der Kneifzange anpacke. Aber ich verurteile auch niemanden, der sie trotzdem nutzt... wenn er denn genau die Funktion ohnehin haben möchte.

Es herrscht zurzeit eine echte KI-Paranoia... und ein unglaublicher Beißreflex mit eingebauter Moral-Keule.Nervt schon ein bisserl...